LLMs en Local (I): LM Studio

- 13 ago 2025

- 5 min de lectura

1. Introducción: ¿Por qué hablar de LLMs en local?

En los últimos años, los Large Language Models (LLMs) han transformado la manera en la que interactuamos con la tecnología: asistentes virtuales, generadores de texto, análisis de datos, programación asistida y mucho más. Sin embargo, la mayoría de estos servicios dependen de la nube, lo que implica costes, limitaciones y, sobre todo, falta de privacidad.

La buena noticia es que, gracias a los avances en modelos abiertos y optimizados, ahora es posible ejecutar potentes LLMs directamente en tu ordenador, sin depender de servidores externos.

En esta serie de artículos te enseñará cómo hacerlo paso a paso, empezando con una sencilla y versátil herramienta: LM Studio.

2. ¿Qué es un LLM? Conceptos básicos

Un Large Language Model es una red neuronal entrenada con grandes cantidades de texto para predecir y generar palabras de manera coherente. Estos modelos son capaces de responder preguntas, generar contenido, resumir documentos, traducir idiomas o incluso razonar sobre problemas complejos.

Cómo funcionan: los LLMs trabajan procesando texto en unidades llamadas tokens, y generan la siguiente palabra en función del contexto previo.

Modelos locales vs en la nube: los modelos en la nube (ChatGPT, Gemini) ofrecen potencia y simplicidad, pero dependen de servidores externos. Los modelos locales, en cambio, se ejecutan en tu propio equipo, dando control total sobre tus datos.

Ejemplos populares para uso local incluyen LLaMA, Mistral, Phi, Gemma y sus variantes optimizadas para hardware doméstico.

3. Ventajas y desventajas de usar LLMs en local

Aspecto | Modelos Locales | Modelos en la Nube |

Privacidad | ✅ Datos permanecen en tu equipo | ❌ Dependen de servidores externos |

Coste | ✅ Gratis en uso | ❌ Suscripciones o pagos por token |

Control | ✅ Personalización total | ❌ Limitado por el proveedor |

Rendimiento | ❌ Depende del hardware | ✅ Servidores potentes |

Facilidad de uso | ❌ Requiere instalación inicial | ✅ Plug & play en el navegador |

No necesitas un superordenador para ejecutar LLMs en local, aunque cuanto más potente sea tu equipo, podrás utilizar modelos de mayor tamaño y disfrutar de una mejor velocidad de respuesta.

Hoy en día existen modelos de todos los tamaños, incluyendo versiones ligeras cuantizadas (Q4, Q5, Q8) que pueden funcionar incluso sin GPU. Eso sí, esta reducción de recursos viene acompañada de una ligera pérdida de precisión en las respuestas.

4. Primeros pasos con LM Studio

4.1. ¿Qué es LM Studio y por qué usarlo?

LM Studio es una aplicación gratuita que permite usar modelos de lenguaje en tu ordenador con una interfaz gráfica sencilla y sin necesidad de conocimientos técnicos.

Compatible con modelos en formato GGUF.

Fácil descarga y gestión de modelos desde la propia aplicación.

Permite chats conversacionales y ajuste de parámetros sin complicaciones.

4.2. Instalación de LM Studio

Descarga LM Studio desde su web oficial.

LM Studio: Download

Instala la aplicación siguiendo el asistente (Windows, macOS, Linux).

LM Studio: Install

Ejecuta LM Studio: se abrirá un panel limpio y listo para configurar.

LM Studio: arrancando la aplicación

4.3. Detalle de las 4 pestañas principales de LM Studio

Antes de empezar a chatear con un modelo, conviene familiarizarse con las cuatro pestañas principales de LM Studio. Esto te ayudará a moverte por la aplicación y aprovechar todas sus funciones:

Chats 🗨️

Es la vista principal para conversar con el modelo.

Permite crear nuevos chats, revisar conversaciones anteriores y guardar sesiones para reutilizarlas más adelante.

Desde aquí puedes cambiar de modelo rápidamente mientras mantienes la conversación.

LM Studio: Chats

Developer 👨💻

Orientada a desarrolladores que quieran usar LM Studio como backend local para sus aplicaciones.

Aquí se encuentran opciones para configurar el servidor local de API y probar integraciones.

Ideal si quieres conectar LM Studio con herramientas externas como VS Code, scripts o aplicaciones web.

LM Studio: Developer

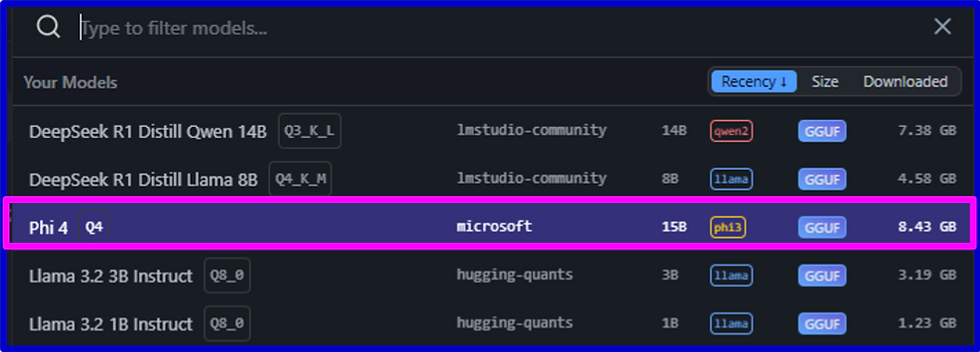

My Models 📂

Lista todos los modelos que tienes descargados y disponibles para usar.

Permite administrar el almacenamiento (borrar modelos, actualizar versiones, etc.).

Muestra información de cada modelo como tamaño, tipo de cuantización y fecha de instalación.

LM Studio: My Models

Discover 🔍

Un buscador integrado para encontrar y descargar nuevos modelos directamente desde Hugging Face y otros repositorios compatibles.

Incluye filtros por tamaño, autor, tipo de tarea (instrucciones, chat, narrativa…).

Desde aquí puedes iniciar la descarga de un modelo con un solo clic.

LM Studio: Discover

4.4. Descargando y gestionando modelos

LM Studio facilita la descarga de modelos directamente desde su interfaz:

Accede a la pestaña My Models.

Busca el modelo que desees:

Ten en cuenta la capacidad de tu maquina a la hora de seleccionar el modelo

A modo de ejemplo vamos a descargar el modelo "Phi" de Microsof

ponemos Phi en la barra del buscador y nos aparecen los distintos modelos descargables

Vamos a escoger el "Phi4" que vemos que ocupa 9,05Gb

LM Studio: download modelo Phi4

Haz clic en Descargar y espera a que finalice.

Una vez descargado, aparecerá en nuestra lista de modelos seleccionables.

Veamos como usarlo en el próximo apartado

4.5. Uso básico: tu primer chat local

Vamos a la pestaña "Chat"

LM Studio: Chats - Load Model

Selecciona uno de los modelos que tengas descargados.

En este caso vamos a seleccionar el modelo "Phi4" que acabamos de descargar

LM Studio: Chats - Select Model

Empezar el chat:

Una vez cargado el modelo seleccionado, ya se podrá escribir tu pregunta en la cuadro del chat

Escribimos nuestra pregunta: "Buenas noches. Explícame la diferencia entre machine learning y deep learning"

LM Studio: iniciar chat

Enviamos la pregunta y el sistema empezará a contestar inmediatamente.

La velocidad de respuesta dependerá de la capacidad de nuestro ordenador y del modelo seleccionado

La calidad de la respuesta dependerá del modelo seleccionado

LM Studio nos va a permitir:

Ajustar parámetros para interactuar con el modelo como por ejemplo temperatura (creatividad), contexto (memoria del chat) o tokens máximos.

Adjuntar documentos a la hora de realizar la pregunta

LM Studio: Chat - Parámetros

5. Caso práctico: usando los modelos de lenguaje open-source de OpenAI en LM Studio

En agosto de 2025, OpenAI publicó varios modelos de lenguaje open-source bajo licencia libre, permitiendo que cualquier persona los descargue y ejecute en su propio ordenador.

Esta iniciativa abre la puerta a que los usuarios puedan aprovechar la calidad de modelos desarrollados por una de las empresas líderes en IA, sin depender de la nube ni de una suscripción.

LM Studio ya soporta la descarga y ejecución directa de estos modelos, lo que hace que su instalación sea extremadamente sencilla.

Vamos a ver como descargarlos y usarlos dentro de LM Studio:

En LM Studio vamos a la pestaña "Discover"

En el buscador escribimos "OpenAI"

Con esto aparecerán para descargar los modelos que ha liberado OpenAI

Vamos a seleccionar el modelo "gpt-oss-20b" de 20 mil millones de parámetros.

Descargamos el modelo

Damos al botón de "Download" para iniciar la descarga.

Este modelo ocupa 12,11Gb

gpt-oss-20b en LM Studio

Vamos a la pestaña "Chat"

Seleccionamos el modelo "gpt-oss-20b"

Iniciamos el chat

Escribimos un prompt

Vamos a preguntar: "que pesa más, un kilo de paja o un kilo de hierro"

pulsamos Enviar y ya estaremos en conversación con el modelo de OpenAI

6. Conclusión

En este primer contacto con los LLMs en local hemos visto que la inteligencia artificial no tiene por qué depender de servidores externos ni de suscripciones mensuales.

Hemos repasado los conceptos básicos de qué es un modelo de lenguaje, sus ventajas y limitaciones cuando se ejecuta en tu propio equipo, y hemos aprendido a utilizar LM Studio como herramienta sencilla para empezar.

Además, hemos explorado un caso práctico muy actual: el uso de los modelos open-source liberados por OpenAI, que ya se pueden descargar e integrar en LM Studio con unos pocos clics.

Con estos conocimientos, ya tienes todo lo necesario para crear tus propios entornos de IA privados, adaptados a tus necesidades y funcionando sin conexión, disfrutando de la libertad y el control que ofrece el uso local.

Comentarios