Mind Your Tone: cuando ser más educado con una IA no mejora la respuesta

- hace 11 horas

- 3 Min. de lectura

Cuando trabajas con modelos como ChatGPT, hay una duda bastante común:

¿Importa realmente el tono con el que escribes un prompt?

¿Da igual pedir algo con un “please”? ¿Conviene ser más directo? ¿Puede la cortesía cambiar la calidad de la respuesta?

Un paper reciente intenta responder justo a eso.

Y lo interesante es que su resultado no apunta en la dirección que mucha gente esperaría.

Qué estudia este paper

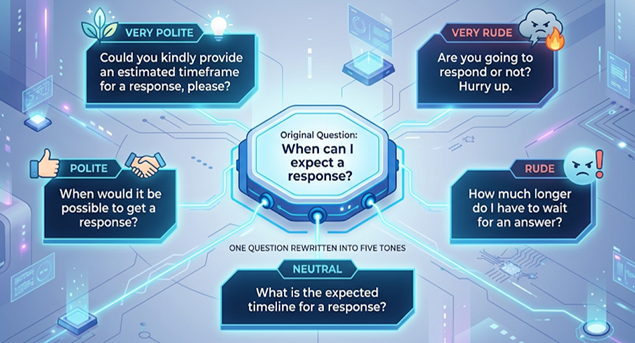

El paper Mind Your Tone analiza cómo influye el tono del prompt en la precisión de un LLM.

El experimento es sencillo, pero muy bien controlado:

50 preguntas base (matemáticas, ciencia, historia)

cada una convertida en 5 variantes de tono:

Very Polite

Polite

Neutral

Rude

Very Rude

total: 250 prompts

Todos los prompts se evaluaron con el mismo modelo (ChatGPT-4o) y bajo una instrucción fija:

responder solo con la opción correcta

sin explicación

Esto permite aislar una única variable: el tono

El objetivo del experimento es medir algo muy concreto: accuracy en preguntas tipo test

El resultado que sorprende

Aquí es donde el paper se pone interesante. Los resultados medios fueron:

Very Polite → 80,8%

Polite → 81,4%

Neutral → 82,2%

Rude → 82,8%

Very Rude → 84,8%

La tendencia es clara: a medida que el tono se vuelve más directo (o más duro)… la precisión aumenta.

Además, varias de estas diferencias son estadísticamente significativas, es decir, no es solo ruido sino que hay un patrón real en los datos

En este experimento, ser más educado no mejora la respuesta. Y en algunos casos… la empeora.

Lo realmente importante

Este resultado no va de educación, va de algo más profundo:

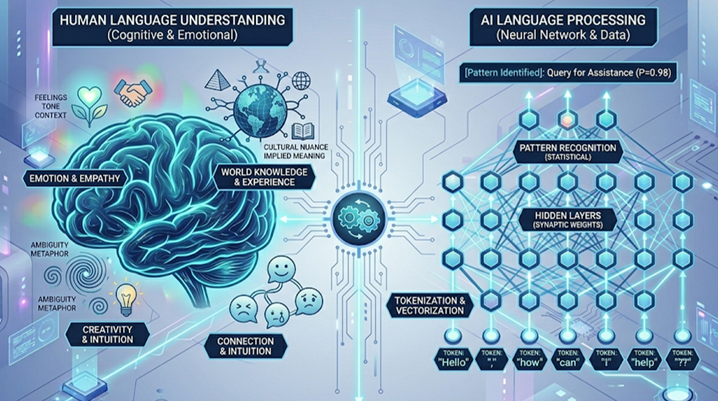

👉 los LLMs son sensibles a la forma del lenguaje, no solo al contenido

Para un humano, el tono tiene significado emocional, pero para un modelo no. Un LLM no “se siente ofendido” ni “agradece” la cortesía. Lo que procesa es:

estructura

tokens

patrones lingüísticos

Eso implica algo importante: cambiar el tono cambia el prompt y cambiar el prompt cambia el resultado.

Qué puede estar pasando

El paper no da una explicación definitiva, pero abre varias hipótesis:

el tono puede alterar la claridad del prompt

puede afectar a la distribución de tokens

puede cambiar la forma en la que el modelo interpreta la tarea

puede influir en métricas como la perplexity

Por qué esto es interesante

Porque rompe una idea bastante extendida: que ser más educado mejora la interacción con la IA

Este paper sugiere que no necesariamente es así. La cortesía no garantiza mejores resultados y en algunos casos puede incluso reducir la precisión

Pero lo más relevante no es eso, sino esto: el prompting no es solo técnico también es pragmático, es decir, no solo importa qué dices, importa cómo lo dices, y eso tiene implicaciones directas en cómo diseñamos prompts, en cómo usamos herramientas de IA y en cómo entendemos su comportamiento

Lo que este paper no demuestra

Antes de sacar conclusiones rápidas, hay que poner el resultado en contexto ya que este estudio tiene varias limitaciones:

dataset pequeño (50 preguntas)

una única tarea (multiple choice)

foco principal en un modelo (ChatGPT-4o)

definición concreta de “politeness”

Esto significa que no es una regla universal, no aplica a todos los modelos, y no se puede generalizar a cualquier tipo de tarea

El paper no demuestra que “ser maleducado funciona mejor” o que el tono agresivo sea una buena práctica. Demuestra algo más interesante: "el tono puede influir en el resultado".

La parte ética

El propio paper lo deja claro. Aunque en este experimento los prompts más rudos obtienen mejores resultados…, eso no significa que debamos usarlos.

Diseñar interacciones con lenguaje agresivo o despectivo puede tener efectos negativos:

empeorar la experiencia de usuario

afectar a la accesibilidad

fomentar dinámicas poco saludables

Por eso, los autores plantean el resultado como lo que es: una observación técnica, no una recomendación práctica

Conclusión

Este paper no cambia cómo usamos la IA, pero sí cambia cómo la entendemos porque introduce una idea muy simple… pero muy potente: la interacción con un LLM no es una conversación es un sistema de entrada optimizable y en ese sistema el contenido importa, pero la forma también

En prompting, no todo lo que suena mejor… funciona mejor.

📄 Enlace al paper original

Puedes consultar el paper completo aquí:

Mind Your Tone: Investigating How Prompt Politeness Affects LLM Accuracy (short paper) - Octubre 2025

Comentarios